Washington D.C., 23 février 2026 – Le Parisien Matin, Le secrétaire à la Défense américain, Pete Hegseth, a convoqué Dario Amodei, PDG d’Anthropic, pour une réunion de crise au Pentagone ce mardi. Au cœur des tensions : l’Utilisation militaire de l’IA en 2026, et plus précisément les restrictions que l’entreprise maintient sur son modèle Claude.

Alors que le Pentagone pousse pour une intégration sans limites de l’intelligence artificielle dans ses réseaux classifiés, Anthropic insiste sur le respect de garde-fous éthiques. Selon des sources proches du dossier, les discussions sur l’Utilisation militaire de l’IA 2026 sont au bord de l’effondrement, le ministère de la Défense menaçant de rompre ses liens avec la startup si elle ne s’aligne pas sur les exigences de flexibilité opérationnelle nécessaires aux forces armées.

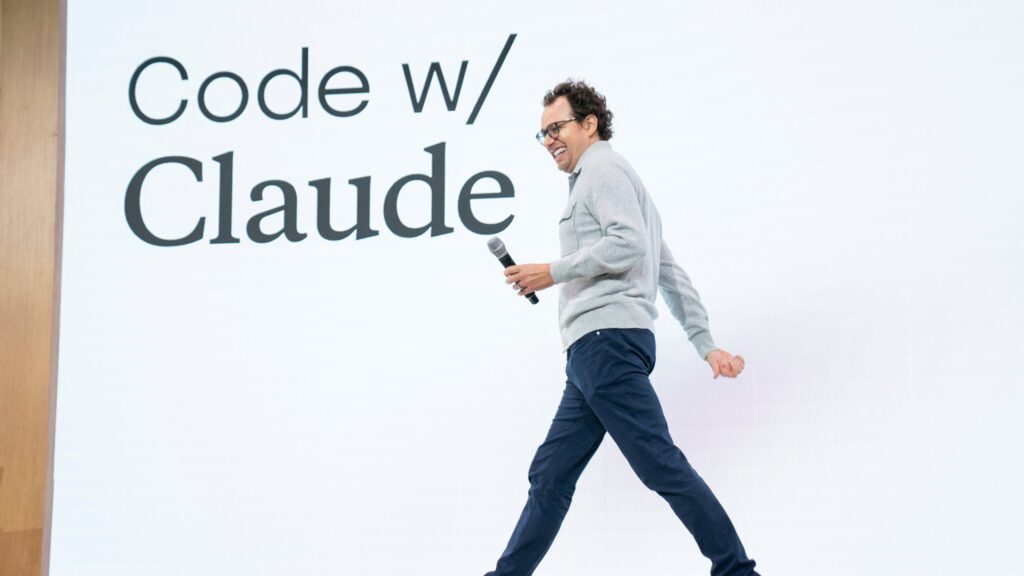

La Résistance Éthique de Dario Amodei

Dario Amodei se retrouve dans une position délicate. D’un côté, la survie commerciale et le patriotisme poussent à la collaboration. De l’autre, la mission fondamentale d’Anthropic repose sur la sécurité et l’alignement de l’IA. Accepter une utilisation militaire de l’IA sans les filtres de sécurité habituels reviendrait à renier les principes fondateurs de l’entreprise.

Les discussions au Pentagone sont décrites comme étant « au bord de l’effondrement ». Le point de friction majeur réside dans la demande du Pentagone d’installer des versions « air-gapped » de Claude. Ces versions fonctionneraient sur des serveurs isolés, empêchant Anthropic de surveiller si l’utilisation militaire de l’IA dérive vers des applications interdites par leur charte.

Vers une Nationalisation de l’Intelligence Artificielle

Si les négociations échouent, le gouvernement américain pourrait envisager des mesures radicales. Certains analystes à Washington suggèrent que le Defense Production Act pourrait être invoqué pour contraindre les entreprises à modifier leurs algorithmes. L’utilisation militaire de l’IA deviendrait alors une réquisition d’État, transformant des outils de productivité civile en armes de précision numérique.

« Nous menons des conversations productives, de bonne foi, pour trouver un équilibre entre innovation et sécurité nationale. » – Un porte-parole d’Anthropic

Les Enjeux Techniques des Réseaux Classifiés

Déployer une IA de pointe sur des réseaux ultra-sécurisés pose des défis immenses. Le Pentagone ne veut pas seulement l’outil ; il veut la capacité d’entraîner le modèle sur des données de terrain en temps réel. Cette utilisation militaire de l’IA nécessite une puissance de calcul locale massive, souvent éloignée des centres de données optimisés de la Silicon Valley.

Le Secrétaire Hegseth insiste sur le fait que la latence et les filtres de modération civils sont incompatibles avec les réalités tactiques. « Nous ne pouvons pas demander à un algorithme de vérifier une charte éthique avant d’identifier une menace imminente », aurait affirmé une source proche du dossier. Cette vision pragmatique de l’utilisation militaire de l’IA s’oppose frontalement à la vision prudente des développeurs.

Le Risque d’une Course aux Armements Algorithmique

L’accélération de l’utilisation militaire de l’IA fait craindre une perte de contrôle. Si les modèles sont dépouillés de leurs mécanismes de sécurité pour gagner en rapidité, le risque de « flash war » (guerre instantanée déclenchée par erreur algorithmique) augmente. Washington est conscient de ce danger, mais estime que le risque de ne pas posséder la meilleure IA est encore plus grand.

Selon les rapports récents, le Pentagone envisage déjà de couper les ponts avec les fournisseurs jugés trop « obstructifs ». Cela ouvrirait la porte à de nouveaux contractants de défense, moins connus du grand public, spécialisés exclusivement dans l’utilisation militaire de l’IA offensive, sans les préoccupations d’image de marque d’une startup grand public.

Le dilemme de la souveraineté technologique américaine

L’utilisation militaire de l’IA soulève une question fondamentale sur la souveraineté des données de défense en 2026. Si le Pentagone ne parvient pas à intégrer Claude AI selon ses propres termes, il risque de devoir développer ses propres modèles en interne, un processus long et coûteux qui pourrait accuser un retard technologique fatal. Pete Hegseth insiste sur le fait que l’utilisation militaire de l’IA ne peut dépendre du bon vouloir de comités d’éthique privés, surtout lorsque la sécurité nationale est en jeu. Cette tension met en lumière la fragilité d’un complexe militaro-industriel qui dépend désormais de startups de la Silicon Valley pour ses capacités de calcul les plus avancées.

L’émergence d’une nouvelle doctrine de cyber-dissuasion

L’issue des discussions entre Dario Amodei et les officiels de Washington pourrait redéfinir la doctrine de dissuasion pour la décennie à venir. Une utilisation militaire de l’IA pleinement débridée permettrait une analyse des menaces à une vitesse dépassant les capacités cognitives humaines, créant un bouclier numérique quasi impénétrable. Cependant, si Anthropic maintient ses restrictions sur l’utilisation militaire de l’IA, le Pentagone pourrait se voir contraint de limiter l’usage de Claude à des tâches administratives, laissant le champ libre à d’autres acteurs moins scrupuleux pour dominer l’espace de bataille algorithmique.

La Mutation des Doctrines de Combat par le Silicium

L’utilisation militaire de l’IA ne se limite plus à la logistique ou à la maintenance prédictive. En 2026, elle infiltre la prise de décision au plus haut niveau. Le conflit entre Hegseth et Amodei est le symptôme d’une transition où le code devient aussi crucial que les munitions. L’issue de cette réunion à Washington déterminera si l’IA restera un outil sous contrôle humain ou si elle deviendra une entité autonome sur l’échiquier des conflits mondiaux.